CES 2026 엔비디아 자율주행 플랫폼 ‘알파마요’ 해부: VLA 추론이 ‘롱테일’을 잡는 방식

CES에서 엔비디아가 매번 “칩”만 꺼내는 회사였냐고요? 이번엔 분위기가 달랐습니다. 젠슨 황이 들고 나온 키워드는 GPU가 아니라, 자율주행을 ‘생각하게 만드는’ 오픈 AI 모델이었거든요. 이름도 묘하게 기억에 남는 알파마요(Alpamayo). 저는 이 발표를 보면서 “아, 자율주행이 이제 규칙 암기 게임을 넘어 ‘추론 플레이’로 넘어가려는구나” 하고 확 느꼈어요.

핵심은 한 줄입니다. 도로 위 사고는 대부분 드물게 터지는데(롱테일), 그 드문 상황을 전부 데이터로 미리 학습시키는 건 현실적으로 불가능하죠. 그래서 엔비디아는 “그럼 사람처럼 상황을 이해하고, 추론하고, 행동하게 만들자”로 방향을 틀었습니다. 알파마요는 그 결론물이에요. 모델 하나만 던지고 끝이 아니라, 오픈 모델 + 시뮬레이션 + 대규모 데이터셋까지 묶어서 “개발 생태계”로 밀어붙인 점이 특히 눈에 띕니다.

오늘은 IT 전문가 관점에서, 알파마요가 정확히 무엇이고(그리고 무엇이 아닌지), 어떻게 구현 구조를 잡았고, 상용화에서 어떤 포인트가 승부처가 될지까지 차근차근 풀어보겠습니다. 너무 과장도, 너무 냉소도 없이요. 딱 실무자의 온도로요.

‘피지컬 AI의 챗GPT 모먼트’가 의미하는 것

“The ChatGPT moment for physical AI is here.”

— NVIDIA, 2026

젠슨 황이 “피지컬 AI의 챗GPT 모먼트”를 말했을 때, 저는 그걸 마케팅 문구로만 보긴 어려웠어요. 왜냐하면 챗GPT 모먼트라는 건 결국 ‘대중이 이해할 수 있는 형태로 기술이 추상에서 제품으로 넘어가는 순간’이거든요. 자율주행에서 그 전환점은 “차가 잘 달린다”가 아니라, 차가 왜 그렇게 달렸는지 설명 가능한 수준으로 안전을 증명하는 쪽에 더 가깝습니다.

기존 자율주행은 크게 두 축이었죠. (1) 센서로 인지하고, (2) 규칙과 플래너로 경로를 만들고, (3) 제어로 실행합니다. 문제는 현실이 너무 변덕스럽다는 겁니다. 나라/문화/날씨/도로 구조가 다르고, 진짜 사고는 “평소에는 안 나오던 조합”에서 터져요. 그래서 알파마요가 던진 메시지는 사실 이거예요. “규칙을 더 쌓는 방식으로는 롱테일을 못 잡는다. 추론이 필요하다.”

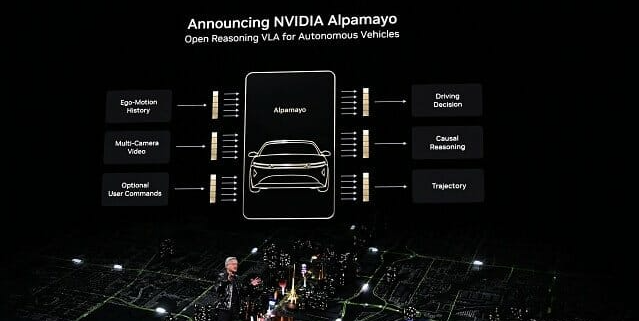

여기서 “추론 기반”이란, 단순히 LLM을 얹는다는 뜻이 아닙니다. 입력(영상·센서)을 보고 상황을 ‘언어적/논리적 표현’으로 재구성한 다음, 그 위에서 행동을 선택하는 구조—즉 VLA(vision-language-action)로 한 몸처럼 묶는다는 의미에 가깝습니다. 저는 이걸 “자율주행 스택의 모놀리식 리팩터링”이라고 부르고 싶어요. (네, 개발자식 표현입니다…)

알파마요 패밀리 3축: 모델·시뮬·데이터셋

알파마요는 오픈 모델(Alpamayo 1), 오픈 시뮬레이션(AlpaSim), 대규모 오픈 주행 데이터셋(1,700+시간)으로 구성된 개발 생태계로 소개됐다.

— NVIDIA Newsroom, 2026

알파마요를 “모델 하나”로만 보면 오해가 생깁니다. 엔비디아가 만든 건 추론 기반 자율주행 개발 사이클이에요. 현장 데이터를 모으고, 합성/시뮬로 롱테일을 증폭하고, 모델을 학습·검증하고, 다시 배포하는 루프를 돌려야 하거든요. 그래서 구성도 3축으로 딱 정리됩니다.

VLA(비전-언어-행동) 추론이 ‘롱테일’을 푸는 방식

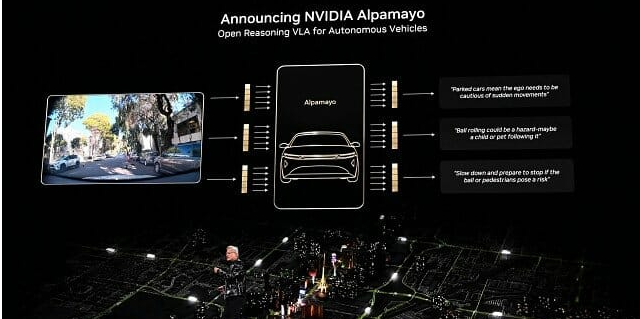

롱테일은 “빈도가 낮다”가 전부가 아닙니다. 원인-결과 연결이 복잡하고, 센서 신호가 애매하며, 도로 위 다른 에이전트(차·보행자)가 예측 불가능하게 움직여요. 그래서 VLA의 핵심은 “보는 것”과 “움직이는 것” 사이에 설명 가능한 중간 표현(언어/논리)을 둬서, 낯선 상황에서도 판단을 이어가게 만드는 겁니다.

- • 상황을 ‘문장’으로 재구성: 단순 객체 인식이 아니라 “앞차가 평행주차를 시작했고 내 차선이 막힐 가능성이 있다”처럼 맥락을 만듭니다.

- • 가설을 세우고 검증: 신호등이 고장인지, 임시 통제인지, 보행자 흐름이 어떤지 등을 근거로 판단을 업데이트합니다.

- • 행동 후보를 비교: 정지/서행/차선 변경/우회 등 선택지를 놓고 위험도를 따집니다.

- • 결정의 이유를 남김: “왜 멈췄는지”를 로그로 남기면, 안전 인증/사고 분석/규제 대응에서 진짜 힘이 됩니다.

- • 일반화의 길: 모든 케이스를 외우는 게 아니라, ‘상황 이해 → 추론 → 행동’의 뼈대를 학습하니 롱테일에 강해집니다.

저는 이 부분이 알파마요의 가장 ‘산업적’인 지점이라고 봐요. 기술이 멋진지보다, 검증/설명/책임의 언어를 제공하느냐가 상용화를 가르거든요.

구현 파이프라인: 코스모스·실주행·자기강화 루프

“그럼 이걸 어떻게 만들었는데?”가 제일 궁금하죠. 기사 초안을 종합하면, 알파마요는 단순히 도로 영상만 모아 학습한 게 아니라, 실주행 데이터를 기반으로 하고 그 위에 현실을 흉내내는 생성/시뮬 계층을 얹어 롱테일을 늘리는 형태로 보입니다. 여기서 코스모스(Cosmos) 같은 월드 모델/생성 모델 계열이 ‘극단 상황’을 만들고, AlpaSim이 검증의 놀이터가 되는 그림이죠.

저는 이 파이프라인을 “자율주행용 RLHF(?)” 같은 느낌으로 읽었어요. 물론 정확히 같은 개념은 아니지만, 인간 운전 시범 데이터와 대량 시뮬/합성을 섞어 “안전한 방향으로” 반복 개선한다는 점에서요. 핵심은 한 번 학습하고 끝내는 게 아니라, 자기강화형 개발 사이클을 굴릴 수 있느냐입니다.

안전·검증 전략: 이중 스택과 NCAP, 그리고 책임의 문제

불확실성이 커지면 규칙 기반 AV 스택으로 전환하는 ‘이중 스택’ 접근을 언급했고, 알파마요 적용 차량이 NCAP 최고 등급을 획득했다고 전했다.

— ZDNET Korea, 2026

추론 모델은 멋있는데, 동시에 위험합니다. “추론한다”는 말은 곧 “확률적으로 말한다”는 의미도 되니까요. 엔비디아가 여기서 꽤 현실적인 선택을 한 것으로 보이는 대목이 이중 스택입니다. 즉, 평소엔 알파마요(추론 기반)가 운전하고, 불확실성이 커지면 완전 검증·추적이 가능한 규칙 기반 스택이 takeover 하는 형태요.

이건 기술의 문제가 아니라, 안전 인증과 책임 소재의 문제를 풀기 위한 아키텍처이기도 합니다. “언제 추론 모델이 운전했고, 왜 그때 규칙 스택으로 넘어갔는지”를 설명해야 하거든요. 그리고 이 설명 가능성이 규제기관/보험/법원의 언어로 번역됩니다. 자율주행 상용화가 늘 ‘기술 70% + 제도 30%’라면, 이중 스택은 그 30%를 겨냥한 선택이에요.

다만, NCAP 최고등급 같은 지표가 “레벨4 완성”을 의미하진 않습니다. 앞으로 남는 과제는 결국 각국 규제 차이, 장거리/장기간 신뢰성 검증, 그리고 AI 판단의 책임이에요. 알파마요는 이 문제를 ‘기술만으로’ 해결하겠다는 게 아니라, 최소한 대화 가능한 구조로 만들겠다는 쪽에 가까워 보입니다.

산업 파급: 로보택시부터 한국 개발팀 체크리스트까지

황 CEO가 “로보택시가 가장 먼저 수혜”라고 말한 건 꽤 합리적입니다. 운영 구역(ODD)을 제한할 수 있고, 차량군을 통제할 수 있고, 데이터 회수가 쉬우니까요. 그리고 엔비디아가 “우리는 플랫폼 제공자”라고 선을 긋는 순간, 경쟁 구도는 테슬라 같은 수직 생태계와는 다른 방향으로 펼쳐집니다. 쉽게 말해, 많은 OEM을 한 번에 묶는 수평 확장을 노리는 거죠.

- • 개발 조직 관점 1: 데이터 수집/정제/라벨링 파이프라인을 “운영”으로 격상할 것 (모델 성능은 결국 데이터 운영력)

- • 개발 조직 관점 2: 시뮬에서 “무슨 시나리오를 얼마나 돌렸는지”를 안전 KPI로 관리할 것

- • 개발 조직 관점 3: 추론 로그를 규제 문서로 번역 가능한 형태로 남길 것(설명 가능성 = 제품 경쟁력)

- • 한국 팀 체크: 국내 도로 특성(끼어들기/이륜차/골목 합류/버스전용차로)을 롱테일로 따로 정의하고, 시뮬·데이터셋에 반영할 것

- • 현실 팁: “레벨4”는 기술만으로는 안 옵니다. 규제·보험·책임 체계를 함께 설계하는 팀이 결국 빨라요.

정리하면, 알파마요는 “자율주행을 한 단계 올린 모델”이라기보다 자율주행을 개선하는 방법론(루프)을 오픈으로 제시한 사건에 가깝습니다. 저는 이게 더 무섭고, 동시에 더 현실적이라고 봐요. 이제 승부는 ‘한 방 성능’이 아니라, ‘안전한 개선 속도’에서 날 가능성이 큽니다.

Q&A

마치며

알파마요를 보고 제가 제일 크게 느낀 건, “자율주행의 경쟁 단위가 바뀌고 있다”는 점이었어요. 이제는 센서가 몇 개냐, 맵이 얼마나 촘촘하냐 같은 이야기만으로는 부족합니다. 드물고 복잡한 상황(롱테일)을 ‘추론’으로 버티고, 그 판단을 설명 가능한 형태로 남기며, 시뮬과 데이터로 안전을 증명하는 루프—이 루프를 누가 더 빠르고 단단하게 돌리느냐가 승부처가 될 가능성이 큽니다.

물론 “피지컬 AI의 챗GPT 모먼트”라는 말이 곧바로 레벨4의 즉시 보급을 뜻하진 않아요. 규제, 책임, 보험, 사회적 수용성까지 함께 움직여야 하니까요. 그럼에도 알파마요 발표가 의미 있는 이유는, 최소한 그 복잡한 문제를 풀기 위한 공학적 형태(오픈 모델·시뮬·데이터셋)를 제시했다는 점입니다. 저는 이 정도면 충분히 ‘게임의 규칙’이 바뀌는 신호라고 봅니다.

다음 글에서는, 알파마요의 VLA 접근을 로보틱스(휴머노이드/산업로봇)로 확장했을 때 어떤 병목이 생기는지—데이터, 안전 인증, 배터리/구동계 현실까지—조금 더 냉정하게 짚어보려 합니다. (기대해도 좋습니다. 저는 이런 “현실적인 미래” 얘기, 정말 좋아하거든요.)

태그: CES 2026, 엔비디아, 알파마요, 자율주행, VLA, 피지컬 AI, 로보택시, AlpaSim, 오픈 데이터셋, 안전인증

'경제, AI 소식' 카테고리의 다른 글

| 전세신탁 완전정복 - 전세신탁 이란? (0) | 2026.01.23 |

|---|---|

| 150조원 국민성장펀드 - 총정리 (0) | 2026.01.20 |

| 파월 ‘대배심 소환장’ 사태 (0) | 2026.01.12 |

| 아이폰18 “출시 포기”가 아니라 ‘출시 분산’이다... (0) | 2026.01.12 |

| 홈플러스, 청산인가 회생인가 - 어디로 가는 (0) | 2026.01.11 |